Ubuntu下Spark开发环境搭建

Ubuntu 64基本环境配置

安装JDK,下载jdk-8u45-linux-x64.tar.gz,解压到/opt/jdk1.8.0_45

安装scala,下载scala-2.11.6.tgz,解压到/opt/scala-2.11.6

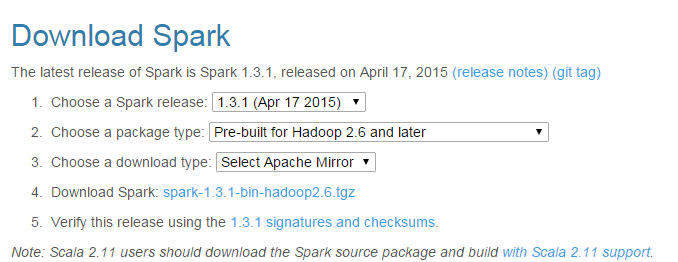

安装Spark,下载spark-1.3.1-bin-hadoop2.6.tgz,解压到/opt/spark-hadoop

下载地址:http://www.oracle.com/technetwork/java/javase/downloads/index.html

下地地址: http://www.scala-lang.org/

下载地址:http://spark.apache.org/downloads.html,

配置环境变量,编辑/etc/profile,执行以下命令

python@ubuntu :~$ sudo gedit /etc/profile

在文件最增加:

#Seeting JDK JDK环境变量

export JAVA_HOME=/opt/jdk1.8.0_45

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:${JRE_HOME}/bin:$PATH

#Seeting Scala Scala环境变量

export SCALA_HOME=/opt/scala-2.11.6

export PATH=${SCALA_HOME}/bin:$PATH

#setting Spark Spark环境变量

export SPARK_HOME=/opt/spark-hadoop/

#PythonPath 将Spark中的pySpark模块增加的Python环境中

export PYTHONPATH=/opt/spark-hadoop/python

测试安装结果

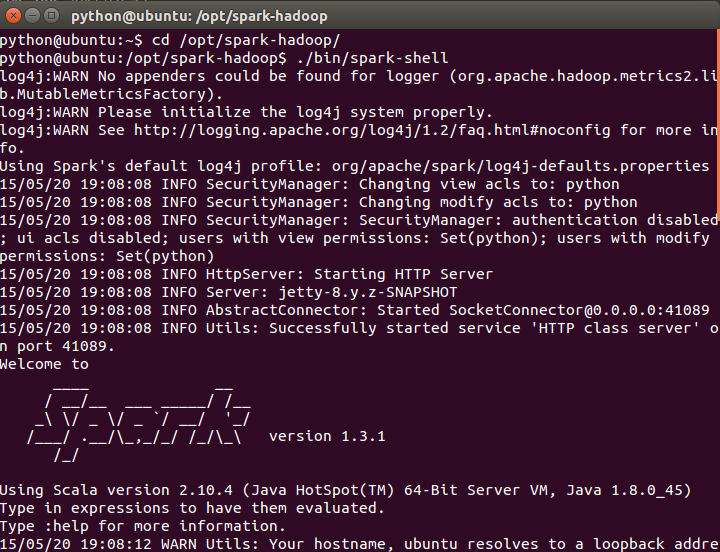

打开命令窗口,切换到Spark根目录

重启电脑,使/etc/profile永久生效,临时生效,打开命令窗口,执行 source /etc/profile 在当前窗口生效

执行 ./bin/spark-shell,打开Scala到Spark的连接窗口

启动过程中无错误信息,出现scala>,启动成功

执行./bin/pyspark ,打开Python到Spark的连接窗口

启动过程中无错误,在出现如上所示时,启动成功。

通过浏览器访问:出现如下页面

测试SPark可用。

Python安发Spark应用

前面已设置PYTHONPATH,将pyspark加入到Python的搜寻路径中

打开Spark安装目录,将Python-》build文件夹下py4j,复至到Python目录下,如图:

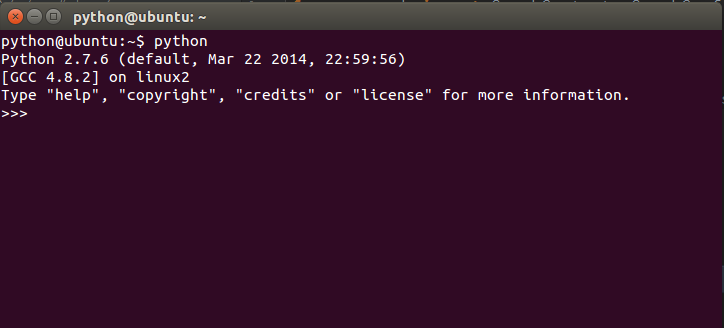

打开命令行窗口,输入python,Python版本为2.7.6,如图所示,注意Spark不支持Python3

输入import pyspark,如下图所示,证明开发前工作完成

使用Pycharm新建项项目,使用红框中的代码测试:

郑重声明:本站内容如果来自互联网及其他传播媒体,其版权均属原媒体及文章作者所有。转载目的在于传递更多信息及用于网络分享,并不代表本站赞同其观点和对其真实性负责,也不构成任何其他建议。